- 发布者:octc

- 来源:octc

- 发布时间:2024-08-21

智能时代,大模型正在重构AI基础设施,数据中心迎来算力、网络、存储、管理、能效的全向Scale(性能增强和规模扩展)创新挑战。那么问题来了,作为力主开放的开放计算社区OCP和开放标准组织OCTC(中国电子工业标准化技术协会开放计算标准工作委员会)将如何应对这些挑战?未来前景如何?刚刚结束的2024开放计算中国峰会给了我们答案。

AIGC时代带来计算新挑战

众所周知,算力、算法和数据是推动人工智能发展的三大要素,尤其是在以大模型为主的AIGC时代,这三者的协同作用尤为显著。自Transformer架构出现以来,大模型性能与其参数量、计算当量、数据量密切相关,这种现象被称为Scaling Law。

随着大模型快速迭代升级,模型能力持续进化,模型类型也从传统的语言模型往多模态、长序列、混合专家模型等转变,由此引发的则是对GPU domain、互联、算力等的新需求,并对基础设施、算力管理、迭代升级等都提出了新的挑战,即生成式人工智能正在重构数据中心基础设施,对计算效能、存储容量及性能、网络方案、资源调度管理、能效控制与管理各个方面均提出了更高要求。

OCTC秘书长,中国电子技术标准化研究院信息技术研究中心硬件研究室主任陈海认为,国内基础设施面临着计算能力、存储能力和网络能力,达不到一些大型模型以及行业模型的实际应用需求的挑战。

“例如在计算能力方面,目前,国内外都出现了许多AI推理训练的加速卡,但因为从硬件层面和它上层的运行软件层面的兼容性,导致多卡异构或者是设备异构的时候,出现了诸多不兼容性的问题,进而造成一个应用场景可能只能应用于一个特定的专用设备之上,无法把算力基础设施拉到一起并行计算。”陈海补充道。

一切计算皆AI,开放计算与时俱进

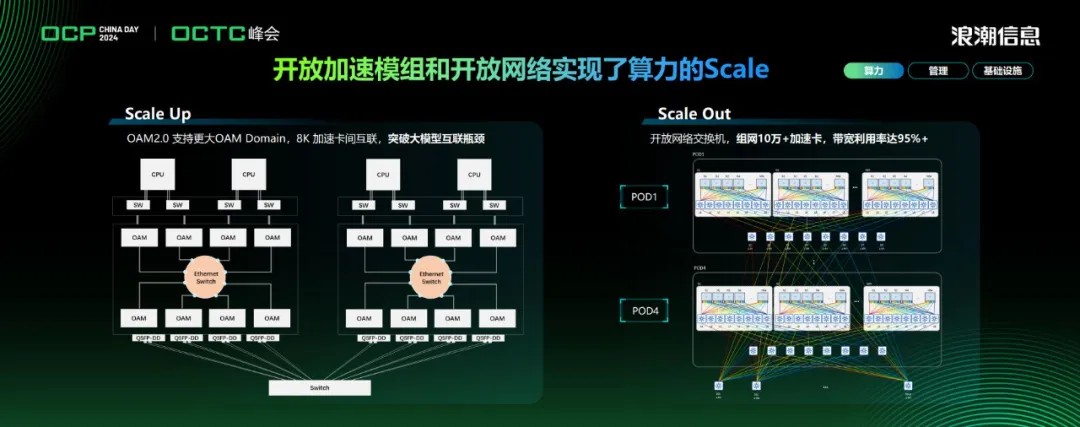

针对上述AIGC时代下,大模型Scaling law对算力扩展的巨大需求—Scale up(单系统性能提升)和Scale out(集群规模扩展)—带来的新挑战,全球化的开放合作变得至关重要。而一直以全球化开放合作为主旨,2011年由Facebook发起成立,目前拥有包括英特尔、微软等在内的超360家企业的OCP和成立两年多的OCTC,在2024开放计算中国峰会向外界展现出了与时俱进应对新挑战的能力。

例如,目前开放计算加速规范(OAM)已成为全球最多高端AI加速芯片遵循的统一设计标准,全球20多家芯片企业支持开放加速规范标准(包括英伟达的HGX的baseboard也符合OAM规范),为AI芯片企业节省研发时间6个月以上,为整体产业研发投入节省数十亿元,极大降低了AI算力产业创新的难度,加速高质量AI算力普惠发展。

值得一提的是,OAM规范还在持续迭代,未来基于OAM2.0规范的AI加速卡将支持8000张加速卡的卡间互联,突破大模型Scale up互联瓶颈。

除了上述的AI芯片和加速卡,在一切计算皆AI的时代,CPU同样需要具有AI能力。但目前CPU多元化发展,如何快速完成CPU到计算系统的创新,使其能够适用于AI推理负载,已经成为缓解当前AI算力稀缺、推动人工智能发展的关键环节。

事实是,目前CPU处理器有10多种,不同CPU处理器的接口和管理协议都不同,每款处理器都要经历从芯片到服务器的12个月左右的产品研发,CPU处理器的研发也亟需实现标准化。

为此,在今年的开放计算中国峰会上,中国电子技术标准化研究院、浪潮信息、百度、英特尔等机构和企业宣布立项开放算力模组(OCM)团体标准,希望建立基于处理器的标准化算力模组单元,统一不同处理器算力单元对外高速互连、管理协议、供电接口等,实现不同架构处理器芯片兼容,方便用户根据应用场景灵活、快速组合,推动算力产业高质量快速发展。

对此,浪潮信息服务器产品线总经理赵帅进一步解释称,OCM标准的本质上把CPU完全解耦,但目前的挑战还比较大,所以浪潮信息做了一个过渡,把CPU内存作为一个最小单元,这样就可以把高速的、前向的和低速的、后向的定义成标准化的接口,对于用户而言,买一台服务器回去,需要用什么样的算力,就可以很方便地选择什么样的算力,并且对于大规模用户而言,它的运维管理非常简单,这些才是开放的OCM对于用户最大的优势和价值。

需要说明的是,除了OCM外,成立仅两年多时间的OCTC已全面布局开放标准建设,并构建起包含基础设施、测评与服务、运维管理等在内的标准框架,遵循通用行业头部用户业务场景需求,覆盖数据中心级液冷系统、全场景整机柜服务器、智能加速卡、数据中心管理等热点方向,并将通用计算、柜计算、AI/异构、液冷等列入标准化建设的重点内容,助力推进数据中心绿色化、智能化、高质量发展。

据陈海介绍,OCTC在攻关技术研究方面,目前累计发布了5项技术白皮书来推动对新技术和组织内达成一致的通用技术推广和宣传应用;在标准方面,联合服务器、存储设备和网络设备厂商立项和发布了12项团体性标准,而这12项团体标准弥补了行业,尤其是与液冷相关的新技术应用的空白。

综上,我们看到,智能时代,“一切计算皆AI”,人工智能算力范式的不断革新正驱动数据中心向更高效、更智能、更绿色、更多元演进,而OCP和OCTC作为当下数据中心持续创新的重要力量,正在以全球化协作与创新,合力解决智能时代下数据中心面临的诸多挑战,如硬件基础设施迭代、软件基础架构融合、数据中心可持续发展等。

众人拾柴火焰高,确保开放计算领先和普惠

OCP和OCTC之所以能够做到在AIGC时代与时俱进,价值倍增,在我们看来,开放方能促进技术的迭代,而让用户真正参与进来,才能更快的看到新技术的发展,让新技术应用到业务中,促进业务的发展,这些才是开放社区的长久繁荣的核心关键点。

与此同时,只有产业链每个厂商都因开源开放而获益,并得到内生动力,开放社区才具备了持续不断地创新和运营的基础。

而在上述过程中,以浪潮信息、阿里云为代表的厂商在社区的贡献实践,核心厂商的参与反哺开放计算社区规模化发展和技术创新贡献,让社区的产品和市场需求匹配,降低参与厂商的获客成本和使用成本。

这里,我们以核心厂商浪潮信息为例,作为OCP、ODCC、Open19、OCTC全球四大开放计算组织的核心成员,浪潮信息在开放社区的参与度越来越深,从贡献设计规范,到参与开发标准,再到牵头标准的制定。

目前,浪潮信息已积极参与面向AI、边缘等标准规范的建立,并牵头服务器全部国标、OAM规范、天蝎标准、边缘OTII规范、OpenBMC、OpenRMC管理标准等。

此外,浪潮信息还同时推动技术标准产品化,率先向社区贡献了多款产品,包括AI开放加速计算系统、OTII边缘计算服务器、符合三大开放组织标准(OCP, ODCC, Open19 )的整机柜产品等等;并在OCTC牵头柜计算技术项目,旨在定义一种高效、统一的整机柜服务器通用技术方案,实现整机柜服务器规模化推广。2024年1月浪潮信息牵头编写《全液冷冷板系统参考设计及验证白皮书》并面向业界开放下载,参编的《基于标准PCIe接口的人工智能加速卡液冷设计白皮书》、《数据中心物理基础设施管理要求白皮书》等也陆续发布。

除浪潮信息外,作为OCP核心厂商之一的阿里云也秉持开放合作的策略,积极参与推动产业发展和繁荣。

比如在标准贡献上,以CXL(Compute Express Link,一种新型高速互联技术)为例,阿里云全程参与了了CXL 1.0/1.1/2.0/3.0/3.1标准的制定和发布,使得阿里在CXL互联的研究和落地上处于国内领先和业界第一梯队的位置。而在UCIe(Universal Chiplet Interconnect Express,即通用芯粒互连技术)领域,阿里云也积极组织相关技术团队参与UCIe多个工作组,参与标准制定工作。

对此,阿里云基础设施服务器研发产业合作总监吴灵熙介绍,作为CXL的初始会员,也是UCIe的初始会员,阿里云现在也在积极参与UALink等Scale up网络开放联盟的筹建工作。阿里云也是最早一批OCP在中国大陆的CSP的白金客户。在开放合作组织中,阿里云看到通过一个更加公平、开放、共享的社区文化,或者是一个开源的宗旨,能够使得整个行业的所有参与者都能在开源组织的活动中得到收益,所以阿里云非常积极地参与进来。

在我们看来,在“一切计算皆AI”的AIGC普及和AI算力已经深入到千行百业,渗透进每一个计算设备,面向人工智能的算力范式不断革新的背景下,如何保持开放计算的领先性和让更多的行业受益,在当下和未来显得至关重要。

对此,OCP基金会新兴市场副总裁Steve Helvie称,OCP的一个主题就是会把超大规模用户的这些最佳实践,尽可能地延展到通用行业,所有行业都可以从在OCP内开发的开放设计中受益。基金会希望能够在通用的行业去配置对他们来说最合适的,从超大规模用户处汲取经验,再把它们应用到其他的行业当中。

无独有偶,赵帅认为,“我们应把开放的理念带入多个行业,而不是只局限在大规模数据中心,因为大规模数据中心是应用的先锋,但是更多的应用场景需要让它在行业里面去落地。而作为OCP的核心厂商,按照浪潮信息目前的体量,前面已经没有引路人了,这个时候我们就必须要用一个更加开放的心态,因为开放意味着有大量崭新的技术、新的idea在这个团队和社区里出现,从而让更多的先进技术快速的产业化落地到行业。在这个过程当中,我们去引领产业发展和技术创新的同时,赋能采用开放标准的企业始终在行业中保持自己先于业内3-5年的领先优势。”

以液冷为例,目前,中国的液冷应用是全球领先的,究其原因,国内基本上六大行,通信头部企业代表都参与到了开放标准的制订,大家均可用,并且是公开的,只有这样,才快速推动了液冷的产业化,真正让液冷进入千行百业。

写在最后:众所周知,从最早的完全垂直封闭的大型机到统一RISC和Unix标准的小型机,再到x86和开放架构服务器,开放计算已经成为不可逆的趋势。而如今AI的爆发,从最开始的Caffe,到pytorch、Paddle、LIama、源等都是开源推动,可以说也是开源开放的胜利。

展望未来,开源开放无疑是AI创新的核心动力,OCP和OCTC两大开放组织在过去一年中,以“破壁”、“开放”的态度共同推动开放计算的广泛应用,构建全球化的开放协作平台,通过数据中心产品技术协同创新、知识产权成果共创共享、标准规范共建等,加速行业数智化、绿色高效发展的事实,让我们相信,开放计算势在AIGC时代大有可为。

注:本文转载自科技自媒体“班门弄斧”官微